Google presenta un algoritmo de compresión que aborda la sobrecarga de memoria en los LLM sin pérdida de precisión

Google ha presentado un algoritmo de compresión que reduce la memoria caché de los modelos de lenguaje grandes (LLM) sin pérdida de precisión, para abordar los cuellos de botella que se generan en la recuperación de información.

TurboQuant aborda el problema de la sobrecarga de memoria en la cuantización vectorial tanto en la compresión de caché clave-valor (KV) como en la búsqueda vectorial, y lo hace junto con las soluciones Quantized Johnson-Lindenstrauss (QJL) y PolarQuant en un proceso de dos fases.

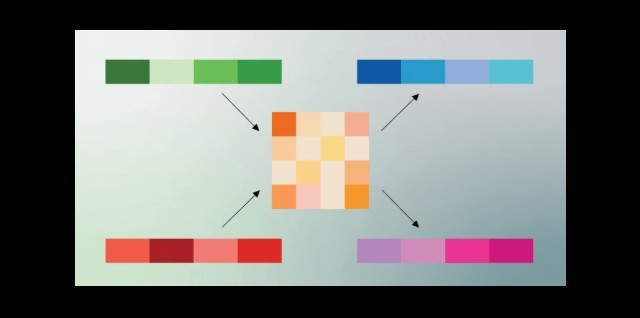

Para entender la importancia de este algoritmo, Google explica en su web que los modelos de inteligencia artificial utilizan vectores para comprender y procesar la información: vectores pequeños que "describen atributos simples, como un punto en un gráfico", y vectores de alta dimensión que "capturan información compleja, como el significado de una palabra".

Los vectores de alta dimensión consumen grandes cantidades de la memoria caché, la memoria que almacena información de uso frecuente para recuperarla más rápido en una búsqueda. Aunque con la técnica de comprensión de cuantización vectorial se resuelve en parte el problema, también se genera otro, ya que, como apuntan desde Google, suele "introducir su propia sobrecarga de memoria", con uno o dos bits adicionales.

Google ha desarrollado TurboQuant para abordar precisamente el problema de la sobrecarga de memoria en la cuantización vectorial. Para ello, utiliza, por un lado, PolarQuant para realizar una comprensión de alta calidad mediante la rotación aleatoria de vectores de datos. Por otro, recurre a QJL para eliminar los errores ocultos que puedan quedar de la etapa anterior.

El resultado es un algoritmo de compresión sin pérdida de precisión, que hace un uso mínimo de memoria y apenas consume tiempo de procesamiento. "Esto hace que la búsqueda semántica a la escala de Google sea más rápida y eficiente", afirma la compañía.

UN POCO DE HUMOR

El anuncio de este algoritmo ha generado una respuesta en las redes sociales, donde algunos usuarios han encontrado cierto paralelismo entre Google y Pied Piper, la empresa emergente fictica de la serie 'Silicon Valley', de HBO.

El motivo se encuentra en que los fundadores de Pied Piper presentaron un algoritmo de compresión que reducía el tamaño de los archivos con una compresión prácticamente sin pérdidas. Lo mismo que Google, solo que en este último caso, aplicado a la IA.